随着聊天机器人ChatGPT的应用以惊人速度席捲全球,亦同时引发了一些关于数据隐私的担忧。由于AI Chatbot会将数据储存在服务器上,有泄漏资料的可能。美国联邦贸易委员会(F.T.C.)

亦针对ChatGPT如何训练AI模型以及处理个人资料的方式,提供相关文件和详细纪录。

根据《路透社》的报导,科技巨头Google 亦向员工表示不要在AI机器人中输入任何敏感资料,ChatGPT﹑其他AI聊天机器人或自家的Bard也不例外。

AI服务公司的员工可以阅读用户和AI聊天机器人的对话内容外,你与AI聊天机器人不只停留于对话纪录中,AI聊天机器人的开发商亦确认了用户所提供的数据会用作训练AI模型用途,所以内容有机会与AI聊天机器人平台上其他使用者分享!

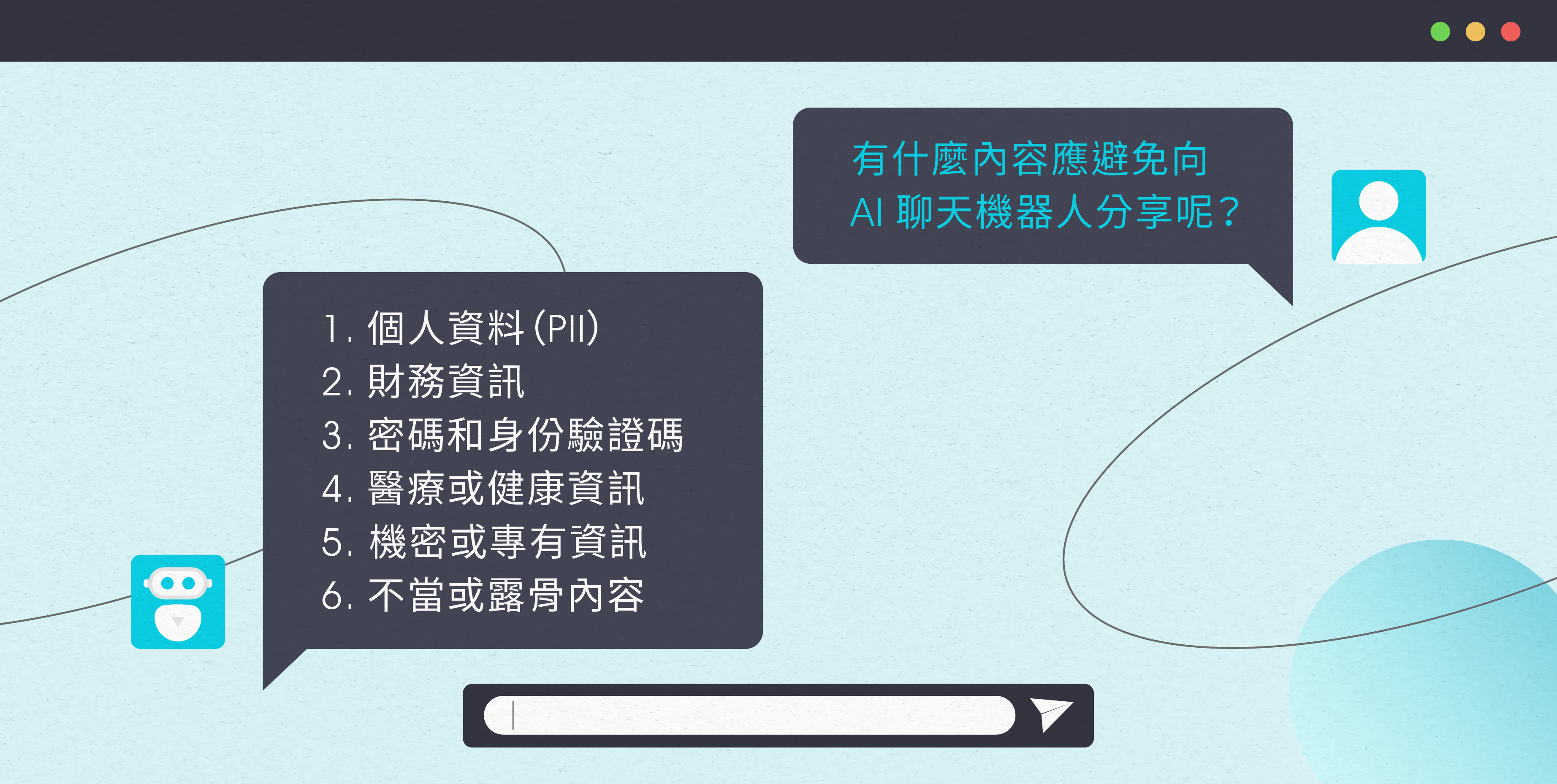

有什麽内容应避免向AI聊天机器人分享呢?

1. 个人资料(PII)

避免分享自己的个人资料,例如个人全名、地址、电话号码、身分证号码或其他可以用于识别自己的信息。

2. 财务资讯

避免详细透露敏感的财务资讯,例如个人信用卡号码、银行帐户资讯或密码等。

3. 密码和身份验证码

不要向AI聊天机器人或任何线上平台透露个人密码、登录帐户/身份验证码等,应将这些信息保密并确保其安全性。

4. 医疗或健康资讯

避免向AI聊天机器人分享任何医疗资讯,包括个人健康状况、诊断结果、治疗详情或用药方案等。这些个人健康问题应谘询合资格的专业医疗人员,并在安全和私密的环境下讨论,防止医疗资讯被滥用。

5. 机密或专有资讯

避免分享商业机密、资讯或任何可能对自己、雇主或组织造成损害的专有资讯。

6. 不当或露骨内容

不应向AI分享露骨或亲密照片、影片或涉及敏感内容的讨论,如仇恨言论、歧视、骚扰或任何违反道德指引或法规的讨论,AI Chatbot亦并非为处理此类内容而设计。

参考资料:Reuters