隨著聊天機器人ChatGPT的應用以驚人速度席捲全球,亦同時引發了一些關於數據隱私的擔憂。由於AI Chatbot會將數據儲存在服務器上,有泄漏資料的可能。美國聯邦貿易委員會(F.T.C.)

亦針對ChatGPT如何訓練AI模型以及處理個人資料的方式,提供相關文件和詳細紀錄。

根據《路透社》的報導,科技巨頭Google 亦向員工表示不要在AI機器人中輸入任何敏感資料,ChatGPT﹑其他AI聊天機器人或自家的Bard也不例外。

AI服務公司的員工可以閱讀用戶和AI聊天機器人的對話內容外,你與AI聊天機器人不只停留於對話紀錄中,AI聊天機器人的開發商亦確認了用戶所提供的數據會用作訓練AI模型用途,所以內容有機會與AI聊天機器人平台上其他使用者分享!

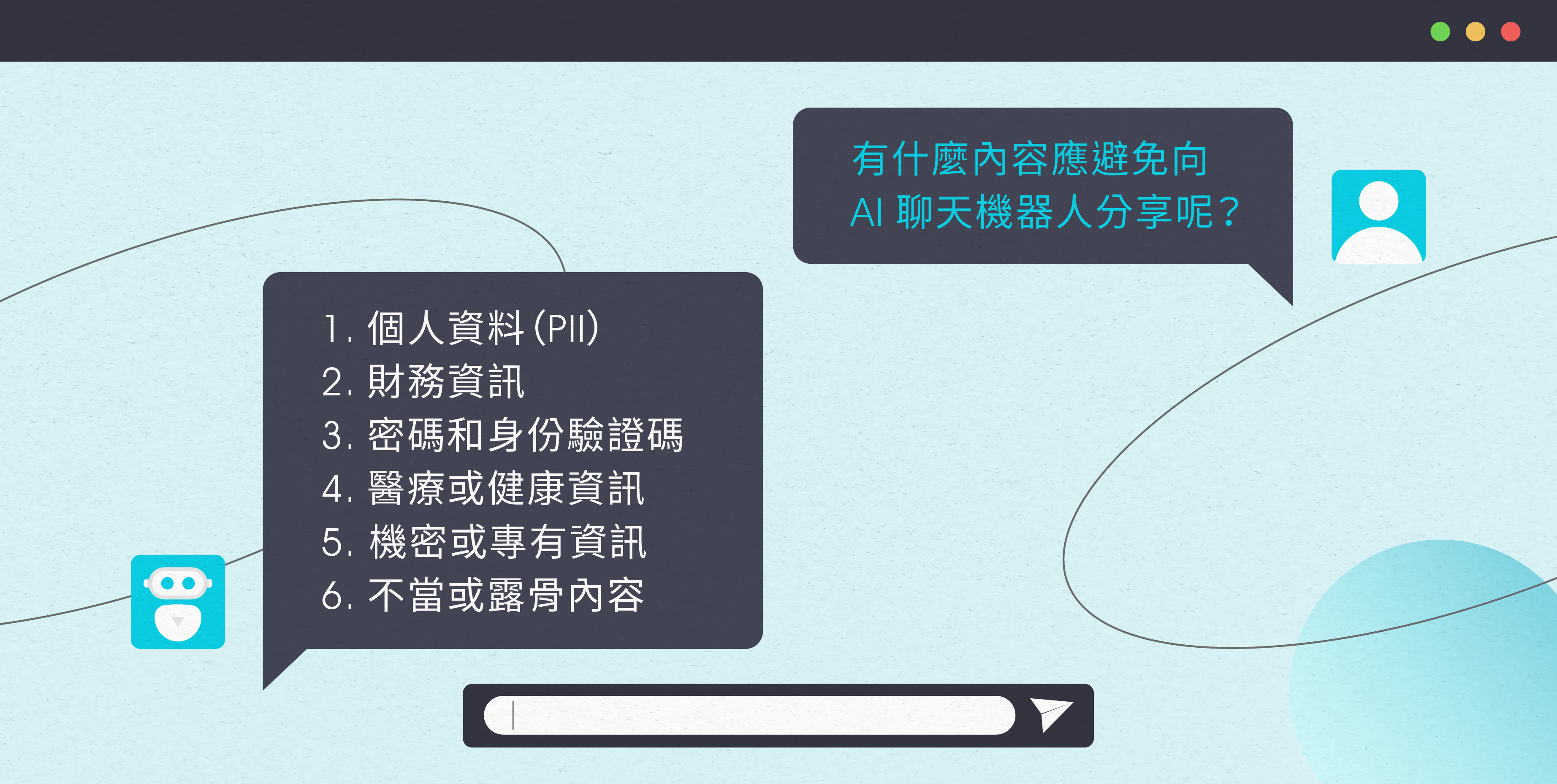

有什麼內容應避免向AI聊天機器人分享呢?

1. 個人資料(PII)

避免分享自己的個人資料,例如個人全名、地址、電話號碼、身分證號碼或其他可以用於識別自己的信息。

2. 財務資訊

避免詳細透露敏感的財務資訊,例如個人信用卡號碼、銀行帳戶資訊或密碼等。

3. 密碼和身份驗證碼

不要向AI聊天機器人或任何線上平台透露個人密碼、登錄帳戶/身份驗證碼等,應將這些信息保密並確保其安全性。

4. 醫療或健康資訊

避免向AI聊天機器人分享任何醫療資訊,包括個人健康狀況、診斷結果、治療詳情或用藥方案等。這些個人健康問題應諮詢合資格的專業醫療人員,並在安全和私密的環境下討論,防止醫療資訊被濫用。

5. 機密或專有資訊

避免分享商業機密、資訊或任何可能對自己、雇主或組織造成損害的專有資訊。

6. 不當或露骨內容

不應向AI分享露骨或親密照片、影片或涉及敏感內容的討論,如仇恨言論、歧視、騷擾或任何違反道德指引或法規的討論,AI Chatbot亦並非為處理此類內容而設計。

參考資料:Reuters